Da anni si è aperto il dibattito sui problemi etici, legali e sociali posti dall’Intelligenza artificiale. Stiamo parlando dell’insieme delle tecniche di realizzazione di macchine in grado di riprodurre attività proprie dell’intelligenza umana. Oltre alle evidenti questioni giuridiche, tutto questo genera anche rilevanti criticità etiche, politiche e sociali, come ad esempio quelle legate alla discriminazione sociale. Qualsiasi cosa faccia una macchina lo fa infatti seguendo degli algoritmi di calcolo che sono programmati da uomini per alimentare i sistemi di intelligenza e che possono essere affetti da errori di diversa natura. Il tema etico si condensa quindi proprio su questa non prevedibilità a priori delle scelte della macchina e su come e in quale misura saremo disposti a tollerare gli errori e le previsioni sbagliate e con quali conseguenze.

I modelli generativi basati sull’Ia utilizzabili per creare contenuti sono esplosi negli ultimi mesi permettendo di creare situazioni ed immagini realistiche partendo da descrizioni testuali. Sta emergendo, in modo tanto sorprendente quanto preoccupante, come le potenzialità espressive possono essere piegate fino a limiti estremi e imprevedibili. Strabilianti sono i video dello youtuber Curious Refuge che ha messo insieme maestri del cinema proponendo mutazioni miste di grandi classici. Ed è noto al riguardo lo scontro in atto tra le principali società hollywoodiane e gli operatori del settore. Lo Screen Actor Guild, sindacato che rappresenta oltre 160.000 attori e professionisti di cinema e Tv, ha indetto uno sciopero generale sulla possibilità di utilizzare l’Ia come alternativa agli umani. Il tema principale ha riguardato una clausola secondo cui i produttori avrebbero potuto tenere in archivio una copia digitale o avatar dell’attore di riferimento. Gli sceneggiatori, a loro volta, temono di essere sostituiti dai robot perché, con pochi clic, Chat Gpt è in grado di creare testi.

Ancora più clamorosa è stata la bufera addirittura su Amnesty International che ha impiegato alcune immagini generate dall’Intelligenza artificiale per supportare le proprie battaglie per i diritti umani in Colombia, per rimarcare la brutalità della polizia durante le proteste del 2021. In particolare una foto pubblicata dal Guardian è apparsa manipolata ed Amnesty si è giustificata spiegando che lo ha fatto per proteggere la privacy e l’identità dei manifestanti. Ma evidentemente la scelta pone seri quesiti etici sul concreto rischio di diffusione di fake molto verosimili.

Grazie all’Intelligenza artificiale, la influencer americana Caryn Marjorie, di 23 anni, ha riprodotto una versione digitale di sé stessa attraverso un’immersione totale in un’esperienza di machine learning (nella quale sono stati ripresi da una copia digitale di chatbot comportamenti, voce e pensiero). Con il suo avatar tanti ragazzi possono condividere pensieri intimi e pianificare esperienze come se stessero con la loro vera fidanzata. Si tratta di una operazione che desta serie perplessità specie in una sfera così delicata come quella sentimentale e sessuale e che secondo le previsioni le farà guadagnare 5 milioni di dollari al mese. Venendo a casa nostra è notissimo il video di Beppe Grillo, autorizzato dal comico e diventato virale, in cui si esprime alla perfezione in cinese, in cui le espressioni facciali e la.

Da anni si è aperto il dibattito sui problemi etici, legali e sociali posti dall’Intelligenza artificiale. Stiamo parlando dell’insieme delle tecniche di realizzazione di macchine in grado di riprodurre attività proprie dell’intelligenza umana. Oltre alle evidenti questioni giuridiche, tutto questo genera anche rilevanti criticità etiche, politiche e sociali, come ad esempio quelle legate alla discriminazione sociale. Qualsiasi cosa faccia una macchina lo fa infatti seguendo degli algoritmi di calcolo che sono programmati da uomini per alimentare i sistemi di intelligenza e che possono essere affetti da errori di diversa natura. Il tema etico si condensa quindi proprio su questa non prevedibilità a priori delle scelte della macchina e su come e in quale misura saremo disposti a tollerare gli errori e le previsioni sbagliate e con quali conseguenze.

I modelli generativi basati sull’Ia utilizzabili per creare contenuti sono esplosi negli ultimi mesi permettendo di creare situazioni ed immagini realistiche partendo da descrizioni testuali. Sta emergendo, in modo tanto sorprendente quanto preoccupante, come le potenzialità espressive possono essere piegate fino a limiti estremi e imprevedibili. Strabilianti sono i video dello youtuber Curious Refuge che ha messo insieme maestri del cinema proponendo mutazioni miste di grandi classici. Ed è noto al riguardo lo scontro in atto tra le principali società hollywoodiane e gli operatori del settore. Lo Screen Actor Guild, sindacato che rappresenta oltre 160.000 attori e professionisti di cinema e Tv, ha indetto uno sciopero generale sulla possibilità di utilizzare l’Ia come alternativa agli umani. Il tema principale ha riguardato una clausola secondo cui i produttori avrebbero potuto tenere in archivio una copia digitale o avatar dell’attore di riferimento. Gli sceneggiatori, a loro volta, temono di essere sostituiti dai robot perché, con pochi clic, Chat Gpt è in grado di creare testi.

Ancora più clamorosa è stata la bufera addirittura su Amnesty International che ha impiegato alcune immagini generate dall’Intelligenza artificiale per supportare le proprie battaglie per i diritti umani in Colombia, per rimarcare la brutalità della polizia durante le proteste del 2021. In particolare una foto pubblicata dal Guardian è apparsa manipolata ed Amnesty si è giustificata spiegando che lo ha fatto per proteggere la privacy e l’identità dei manifestanti. Ma evidentemente la scelta pone seri quesiti etici sul concreto rischio di diffusione di fake molto verosimili.

Grazie all’Intelligenza artificiale, la influencer americana Caryn Marjorie, di 23 anni, ha riprodotto una versione digitale di sé stessa attraverso un’immersione totale in un’esperienza di machine learning (nella quale sono stati ripresi da una copia digitale di chatbot comportamenti, voce e pensiero). Con il suo avatar tanti ragazzi possono condividere pensieri intimi e pianificare esperienze come se stessero con la loro vera fidanzata. Si tratta di una operazione che desta serie perplessità specie in una sfera così delicata come quella sentimentale e sessuale e che secondo le previsioni le farà guadagnare 5 milioni di dollari al mese. Venendo a casa nostra è notissimo il video di Beppe Grillo, autorizzato dal comico e diventato virale, in cui si esprime alla perfezione in cinese, in cui le espressioni facciali e la sua voce sono il frutto della combinazione di intelligenze artificiali che svolgono compiti differenti.

Ormai molti esperti puntano il dito contro la fenomenologia e i suoi rischi. Fra questi anche Elon Musk e il co-fondatore di Apple, Steve Wozniak. In verità già il celebre fisico britannico, Stephen Hawking, morto nel 2018, in un’intervista rilasciata nel 2014, ammoniva che lo sviluppo di un’Intelligenza artificiale potrebbe essere esiziale in quanto gli esseri umani, che sono limitati dalla lenta evoluzione biologica, non potrebbero competere e verrebbero sostituiti. Secondo il World Economic Forum, entro il 2027, potrebbero essere spazzati via 14 milioni di posti di lavoro in tutto il mondo. Nel frattempo Joe Biden ha ricevuto i capi delle grandi aziende, per capire la posta in gioco e chiedere loro di portare avanti il lavoro in maniera sostenibile. Idealmente, l’Ia dovrebbe essere in grado di tenere conto dei valori sociali, delle considerazioni morali ed etiche, di soppesare le rispettive priorità valoriali nei vari contesti culturali e di garantirne la trasparenza. Ma allo stato non esistono standard chiari neppure sulle questioni basiche riguardanti privacy e gestione dei dati raccolti.

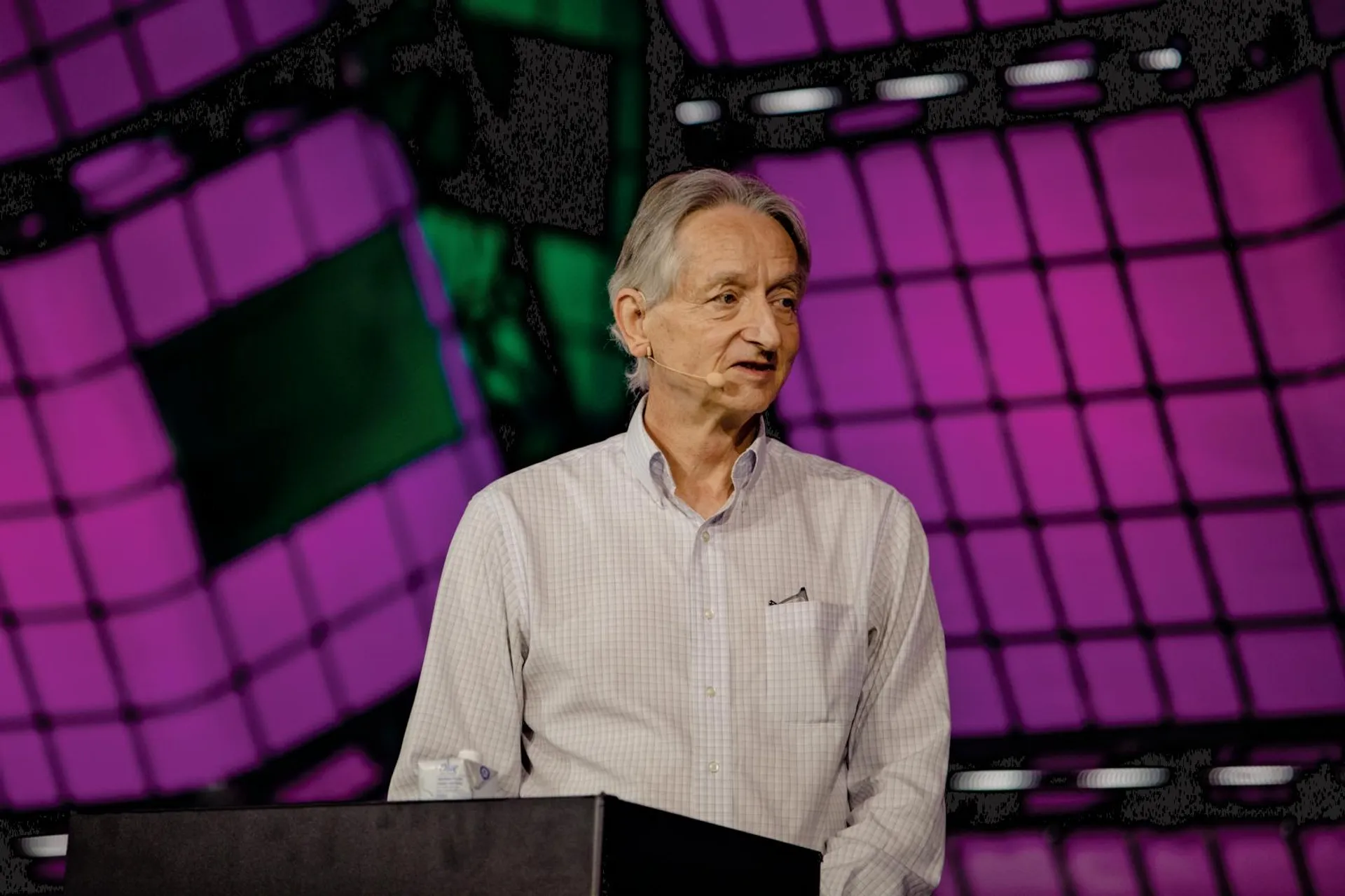

Al di là dei catastrofismi, il pericolo appare ancora più incombente da quando uno degli stessi padri del fenomeno, Geoffrey Hinton, quasi pentito, ha affermato: «Pensavo che questi modelli lavorassero come il cervello. Invece sono in grado di sapere migliaia di volte quello che sanno gli umani… Possono essere in grado di manipolare le persone ed anche se fissassimo delle regole, questi sistemi potrebbero impararle e superarle. Questi non hanno degli obiettivi di evoluzione prestabiliti, ma prima o poi li potranno creare, se perdiamo il controllo. È difficile impedire alle persone di farne un uso scorretto».

Insomma la questione vera è che l’Intelligenza artificiale in sé non ha né una etica né una morale ed assume quella del programmatore che l’addestra (angelo o diavolo che sia) con tutte le conseguenze immaginabili del caso, che ora è tempo di affrontare.