Il risarcimento chiesto dal New York Times a OpenAi e alla creatura di Microsoft, cioè ChatGpt, segna uno spartiacque. Aziende giornalistiche, autori e comuni cittadini al di là e, come vedremo, al di qua dell’Oceano cominciano a chiedere il conto al digitale e all’intelligenza artificiale per l’utilizzo dei propri dati. Nelle 69 pagine della citazione alla corte distrettuale del Southern District di New York, i legali del giornale raccontano che OpenAi è nata nel 2015 come non profit per il bene dell’umanità, per poi trasformarsi in una profit dura e pura tre anni più tardi, fino a raggiungere un valore stimato di 90 miliardi di dollari e puntare a oltre un miliardo di ricavi nel 2024. «Il fulcro di questa causa è determinare se OpenAi si possa avvalere del fair use, cioè dell’utilizzo equo a beneficio dell’umanità, per l’addestramento dell’intelligenza artificiale», spiega l’avvocato Marco Ciurcina, esperto di proprietà industriale e intellettuale. In sostanza, i legali del Nyt sostengono che OpenAi non abbia più fra le proprie priorità il benessere dell’universo, bensì la pienezza del proprio portafoglio, sfruttando a costo zero gli articoli del New York Times. Negli Stati Uniti si è aperto un grande dibattito.

In Europa e in Italia il diritto d’autore è tutelato in modo un po’ più stringente, attraverso la direttiva europea sul digital copyright, introdotta nel 2019 e recepita nel 2021 dal nostro legislatore. Dunque, se per gli editori italiani ed europei, in teoria, è sufficiente inserire la dicitura «riproduzione riservata» a piè di articolo per evitare che una qualsiasi intelligenza artificiale possa utilizzarla, sono i privati cittadini a scaldare i motori verso una stagione di cause giudiziarie in nome della proprietà dei dati. «Fino all’inizio del 2023 era difficile ottenere un risarcimento danni per chiunque avesse subito un furto di dati, se non altro perché è necessario provare l’entità e il tipo di danno subìto. Il danno, spesso, consiste nel patimento di sapere che i propri dati, sensibili o no, sono nelle mani di qualcuno che potrebbe usarli chissà come: questo per la Cassazione non è sufficiente per richiedere un indennizzo», spiega l’avvocato. Tuttavia, nel corso del 2023 due sentenze della Corte di Giustizia dell’Unione europea hanno cambiato tutto, «sostenendo che anche il timore di poter subire un danno è di per sé un danno. Ad esempio, il rischio che qualcuno possa essere discriminato sessualmente o scartato sul posto di lavoro o perseguitato sui social perché le proprie informazioni sono state rubate o sono finite nelle mani sbagliate è sufficiente per chiedere un risarcimento del danno a qualsiasi ente», dalla banca alle Poste, passando per le banche di dati sanitari regionali, fino al patrimonio di materiali nelle mani dei colossi dei social che non hanno custodito abbastanza bene le informazioni in loro possesso o le hanno cedute a terzi. Insomma, le due sentenze della Corte Ue potrebbero dare il via a una stagione di contenziosi, proprio come sta avvenendo dall’altra parte dell’Oceano.

Soluzioni all’orizzonte? La Commissione europea sembra avere giocato d’anticipo: con la pubblicazione del Data Act, avvenuta a fine dicembre, l’obiettivo è creare piattaforme pubbliche per la restituzione dei dati e delle informazioni digitali ai cittadini, attraverso un sistema di «altruismo dei dati». Sostanzialmente si chiederà ai cittadini di essere più generosi e consentire a determinati enti di poter utilizzare quei dati per migliorare la qualità della vita. Fra gli obiettivi del Data Act, per esempio, c’è il sostegno a iniziative civiche di prevenzione ambientale e di cura del territorio o che sfruttino i dati per monitorare la filiera dei subappalti (oggi estremamente opaca) e ridurre le morti sul lavoro, oppure per contrastare la povertà educativa e altro ancora.

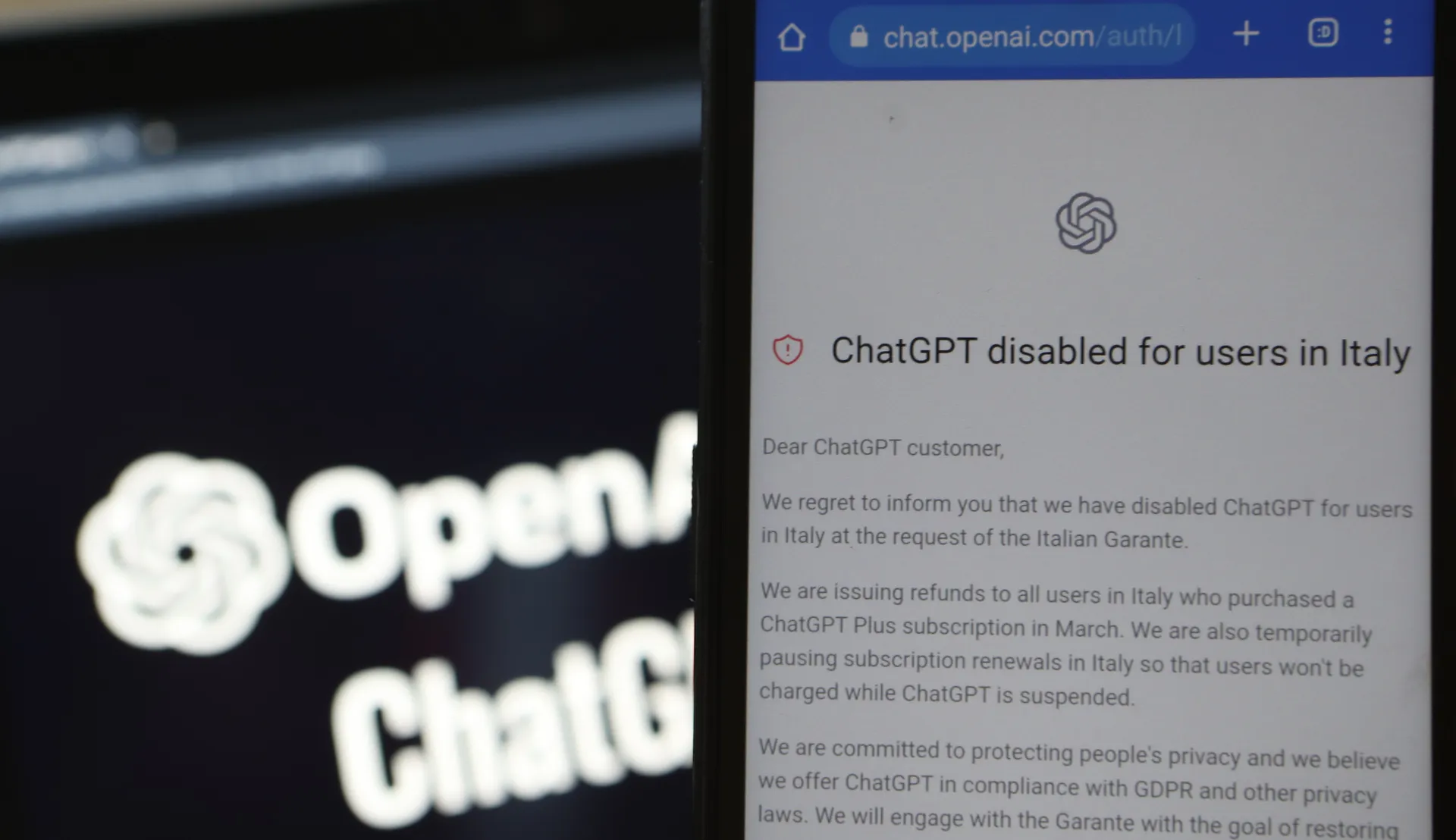

La strada, ovviamente, è in salita, come fa notare Giulio De Petra del Forum Disuguaglianze Diversità: «Sono apprezzabili le norme del Data Act, ma sappiamo che l’enorme sproporzione di forze tra i regolatori nazionali e le grandi imprese digitali renderà difficili il controllo e l’effettiva applicazione di ogni regola. Il confronto tra il garante italiano e ChatGtpt ne è stato un esempio significativo». Insomma, il Data Act rischia di rimanere lettera morta, specialmente in Italia dove la gestione dei dati è tutt’altro che limpida. Sia le amministrazioni pubbliche sia i privati possiedono una montagna di informazioni «che non rendono disponibili, come nel caso delle aziende locali di trasporto o degli appalti finanziati dal pubblico, o che fingono di concedere, per esempio offrendo dati non navigabili», spiega De Petra che vede lontano l’obiettivo di spezzare il capitalismo della sorveglianza, come indicato nel manifesto “Liberare la conoscenza per ridurre la disuguaglianza” del Forum DD. «Non serve una generica infrastruttura digitale, ma uno strumento utile all’interno di ambiti specifici che coinvolgono attori sociali consapevoli e attivi. Sono tutte realizzazioni che potrebbero già oggi essere concrete grazie a mezzi, competenze ed esperienze già operanti», come dimostra ad esempio l’infrastruttura per il monitoraggio dei progetti del Pnrr realizzata da Openpolis.

Tuttavia, proprio Openpolis ha fatto notare a più riprese le gigantesche voragini di dati e informazioni sulle attività del Pnrr, perché troppo spesso questi ultimi non sono accessibili, utilizzabili, o sono di scarsa qualità e non consentono interazione.