Innovazione

14 ottobre, 2025Nella lotta ai “video falsi che sembrano veri” – non esiste una traduzione per il termine deepfake – l’Italia prova a segnare una svolta: con l’entrata in vigore della Legge 132/2025, il nostro diventa il primo Paese in Europa a dotarsi di una normativa organica sull’intelligenza artificiale. Tra le novità più discusse l’introduzione nel codice penale del reato di diffusione di contenuti manipolati digitalmente

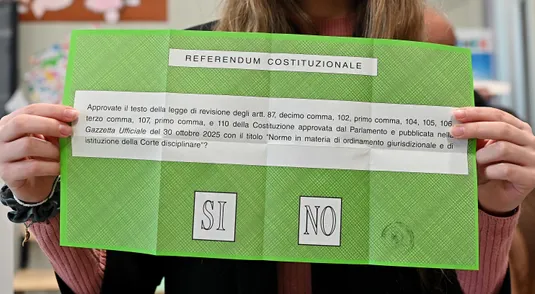

La legge, pubblicata in Gazzetta Ufficiale il 25 settembre e ora pienamente operativa, rappresenta una svolta legislativa notevole. Contestata da molti – considerata un “inutile duplicato” rispetto all’Ai Act europeo – prova a regolamentare l’ambito delle “nuove tecnologie” il cui rapido diffondersi ha conseguenze dirette sul comparto industriale, sulle attività produttive e sul mercato del lavoro, ma anche sulle vite quotidiane dei cittadini.

Il reato di deepfake

La Legge 132/2025 non parla espressamente di “deepfake”, ma si esprime in questi termini: “Chiunque cagiona un danno ingiusto a una persona, cedendo, pubblicando o altrimenti diffondendo, senza il suo consenso, immagini, video o voci falsificati o alterati mediante l’impiego di sistemi di intelligenza artificiale e idonei a indurre in inganno sulla loro genuinità, è punito con la reclusione da uno a cinque anni”. E chi ha orecchie per intendere, intenda.

Si parla quindi di “delitto” perseguibile su querela della persona offesa, ma in alcune circostanze — se la vittima è incapace per età o infermità, o se l’atto colpisce una pubblica autorità — la magistratura potrà procedere d’ufficio, avviando l’azione penale pur in assenza di azione legale della parte offesa.

Cosa cambia rispetto al pregresso? Le leggi in vigore fino ad oggi non prevedevano la fattispecie penale per l’uso illecito di contenuti manipolati digitalmente, tranne che in caso di revenge porn a contenuto sessuale. Mentre ora la nuova norma ora estende il reato a ogni uso distorto dell’immagine e della voce.

Il caso "istituzionale"

L’intervento legislativo potrebbe avere una sua ratio: negli ultimi mesi si è registrata un’escalation di casi in cui anche le figure pubbliche sono state oggetto di “repliche digitali artefatte” digitalmente, che hanno ingannato migliaia di cittadini.

Un esempio emblematico riguarda la diffusione sui social di video falsi che mostravano la presidente del Consiglio Giorgia Meloni, e il vicepremier Matteo Salvini, intenti a promuovere investimenti su piattaforme di trading online. In queste clip, il cui la presidente Meloni appariva nello studio televisivo di un credibile ma altrettanto fake Francesco Giorgino, invitando gli italiani a investire la cifra di 250 euro in un servizio digitale “ufficialmente” sostenuto dal governo, garantendo “guadagni facili e ottimi rendimenti”. Tutto falso, ma la gente ci ha creduto.

Obiettivo: opinione pubblica

Sono video chiaramente falsi, creati e diffusi con l’obiettivo di spingere gli utenti a cliccare su link a piattaforme fraudolente con lo scopo di ottenere dati personali e bancari dei malcapitati "creduloni". Una nuova frontiera della truffa digitale che non si limita al furto economico, ma rappresenta anche un rischio di manipolazione dell’opinione pubblica e di compromissione della fiducia nelle istituzioni. In casi come questi, il deepfake colpisce la reputazione individuale e al contempo mina la credibilità delle fonti e la percezione stessa della verità.

Il confine legale

La Legge 132/2025 introduce un nuovo reato penale, ridefinendo il perimetro giuridico dell’uso dell’intelligenza artificiale. Il testo normativo prevede che ogni contenuto realizzato con l’ausilio di sistemi di AI debba essere dichiarato in modo esplicito e visibile, una misura atta a garantire trasparenza, contrastando l’uso ingannevole di tecnologie capaci di falsificare la realtà. Con la nuova norma viene anche introdotta l’aggravante comune per chi commette reati servendosi di sistemi di intelligenza artificiale. In altre parole le pene aumentano nel caso l’algoritmo usato renda l’azione più insidiosa o ostacoli la difesa della vittima. Anche i reati economici e politici, come l’aggiotaggio e l’attentato ai diritti politici del cittadino, prevedono sanzioni più severe quando commessi tramite IA.

Innovazione e prevenzione

L’Italia sceglie di anticipare le mosse dell’Europa e di allinearsi, con proprie peculiarità, ai principi contenuti nell’AI Act europeo: trasparenza, controllo umano, tutela dei diritti fondamentali e responsabilità penale chiara in caso di abusi. Le imprese, in questo nuovo scenario, saranno chiamate a integrare l’AI nei propri modelli organizzativi con meccanismi di audit, supervisione e responsabilità definiti. Allo stesso tempo, i cittadini disporranno di strumenti di tutela più solidi contro la manipolazione digitale.

Uso lecito della tecnologia

L’introduzione del reato di deepfake segna un confine netto tra uso lecito e illecito della tecnologia. Se fino a oggi la creazione di contenuti falsificati poteva essere un terreno grigio dal punto di vista legale, ora chi diffonde video o audio alterati con l’Ia, causando un danno, rischia da uno a cinque anni di carcere. Questa svolta normativa arriva in un momento cruciale, in cui la capacità delle macchine di replicare la realtà va spesso oltre la percezione umana. Il falso paga, o almeno si spera.

LEGGI ANCHE

L'E COMMUNITY

Entra nella nostra community Whatsapp

L'edicola

Perché dico No - Cosa c'è nel nuovo numero de L'Espresso

Il settimanale, da venerdì 20 marzo, è disponibile in edicola e in app