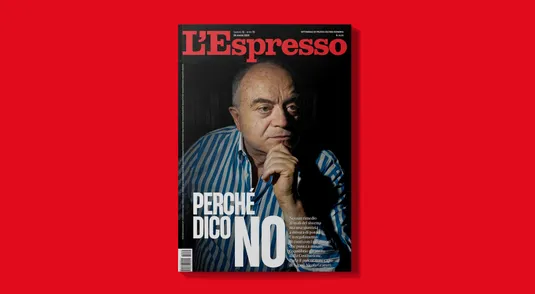

Intelligenza generativa, work in progress. Tim Cook aveva annunciato il lancio dell’Apple Intelligence, salvo poi chiarire che non sarebbe sbarcata in Europa, non a breve. E quanti si erano affrettati a registrare il salto in Borsa del titolo Apple dopo l’annuncio, e quelli che avevano rimproverato la Mela di Cupertino per il ritardo con cui si approcciava al mercato dell’Ia sono tutti rimasti un po’ delusi. Noi ci siamo chiesti perché Apple Intelligence non sarà sui nostri iPhone 16 dal prossimo settembre e abbiamo girato la domanda a Guido Scorza, componente del Garante della Privacy italiano.

Davvero l’Apple Intelligence non ci riguarderà?

«Ci riguarderà a breve. Apple Intelligence è un nome nuovo per un servizio che sarà potenziato, ma nuovo non è; sullo smartphone già transitano app e servizi di Ia. Quando Apple ha fatto l’annuncio, pare ci fosse l’intenzione di sbarcare anche in Europa. Il cambio di marcia è arrivato dopo, forse per un approfondimento sulle questioni legali o un’eventuale interlocuzione informale con Bruxelles, chissà. Di fatto la dichiarazione dell’azienda parla di un rinvio del lancio in Europa per la necessità di essere compliance rispetto al Digital Market Act (Dma)».

L’Apple Intelligence in cantiere a Cupertino sarà eseguita direttamente sull’iPhone e potrà interfacciarsi con provider Ia, per ora ChatGpt, ma si parla di Google e addirittura Meta.

«Apple dovrà necessariamente aprire l’accesso al suo sistema per tutti i fornitori di Ia, lo prevede la norma europea. Ma Apple al momento ha avviato solo l’accordo “one to one” con OpenAI. Quindi largo a Google e Meta, ma in prospettiva tutti dovranno poter transitare per iPhone e dispositivi Apple, per un mix di politica commerciale e obbligo regolamentare».

Si parla di integrazione nativa dell’Ia nell’ecosistema Apple, in cosa si traduce per i consumer?

«In un livello superiore di utilizzo delle soluzioni di Ia. La killer application degli smartphone è la facilità d’uso e sarà applicata anche all’Ia. Se 25 anni fa non tutti avevano facilità di accesso al sistema di programmazione informatica Ms-DoS, l’interfaccia in stile Apple ha introdotto l’usabilità, strumento di democratizzazione straordinaria che ha permesso l’accesso alla tecnologia da parte di pubblici sempre più ampi».

Ci vorrebbe un manuale di istruzioni?

«I primi forni a microonde venivano considerati pericolosi e avevano un book di avvertenze, della serie: prima leggi e poi accendi. Gli iPhone non hanno un manuale di istruzioni: Apple ha giocato e vinto la partita su interfacce e usabilità del dispositivo. E la promessa è la stessa con l’Ia. Ma la facilità d’uso persuade i più che non sia necessario “accendere il cervello” prima di approcciarsi a un nuovo dispositivo. Il rischio quindi non è nell’Ia in sé, ma nella massificazione dell’utilizzo».

Guardiamo ai deep fake, una tecnologia che è già diffusa, ma se basterà schiacciare un pulsantino per modificare una foto su iPhone, un minuto dopo ci ritroveremo con un milione fake in giro per il Web. E con un problema enorme.

«Bisognerebbe dire ai grandi, Apple inclusa, che c’è un limite alla semplificazione: chi utilizza tecnologie così potenti dovrebbe avere chiaro che serve, metaforicamente, mettere il casco o allacciare la cintura di sicurezza per non fare male a sé o agli altri. Bisognerebbe proprio fornire un libretto di istruzioni».

L’Italia ha varato un ddl sull’Ia il 23 aprile per equiparare il sistema normativo a quello europeo. Una visione lungimirante? O un vincolo per lo sviluppo di innovazione e tecnologia in Italia e in Europa?

«La norma europea è stata pubblicata in Gazzetta e in quanto regolamento è già applicabile da tutti i Paesi membri, senza delibere attuative locali. Il ddl italiano ne ripercorre i termini e aggiunge aggravanti per reati commessi con l’Ia. Il rischio è che non migliori la qualità del mercato, ma crei uno sbarramento per le piccole realtà. In sé il decreto male non fa, è pieno di disposizioni di buon senso in larga parte figlie del regolamento Ue. Ho il dubbio che fosse strettamente necessario adottare una norma italiana quando c’è già quella europea».

Il Garante della Privacy italiano è stato il primo a bloccare OpenAI e ChatGpt lo scorso anno; siete al lavoro anche per l’Apple Intelligence?

«All’epoca OpenAI non aveva uno stabilimento principale in nessun Paese europeo, ciò consentiva a qualunque Autorità europea di intervenire. Ora, però, OpenAI ha aperto una sede a Dublino, come anche Apple, e quindi, se ci fosse una violazione della disciplina europea sulla privacy, l’azione istruttoria spetterebbe all’autorità del Paese competente».