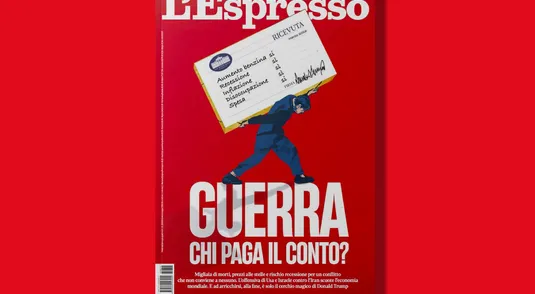

Lo scorso marzo, la ricercatrice senior dell’istituto per la pace Project Ploughshares, Branka Marijan, ha scritto su Scientific American che l’aggressione Russa «sta diventando un disgraziato precedente» per capire il futuro dell’Intelligenza artificiale in guerra. L’Espresso l’ha raggiunta per chiederle cosa abbiamo imparato da questo “precedente”, nei primi sette mesi del conflitto.

Marijan, l’AI si è dimostrata perlopiù benefica o dannosa?

«Non abbiamo ancora un quadro completo degli usi e degli effetti dell’Ai sul conflitto. La mia preoccupazione è che in Ucraina vengano messi alla prova nuovi armamenti intelligenti. Per ora non c’è conferma che ciò sia avvenuto. Ma più il conflitto va per le lunghe più è probabile ne aumenti la seduzione. La Russia potrebbe pensare che tecnologie di questo tipo le darebbero un vantaggio competitivo, e finire per farvi ricorso anche qualora non fossero ancora pronte per l’uso sul campo. Un aspetto spesso trascurato della guerra in Ucraina è poi che i dati prodotti durante il conflitto saranno usati per addestrare i sistemi russi a base di Ai. Quei dati sono cruciali per il training, dato che non sono il risultato di simulazioni ma di informazioni provenienti da reali e recenti operazioni sul campo».

Quali tra gli usi dell’Ai che ha testimoniato nel corso dell’invasione sono più problematici?

«C’è stato un certo dibattito sul possibile uso di un drone autonomo, il drone kamikaze Kub-Bla. Tuttavia, non è chiaro se il drone funzioni davvero in modo del tutto autonomo o anche solo se disponga di una Ai adeguata per farlo. La mancanza di norme e regole sul funzionamento di armamenti con funzionalità autonome è ancora più preoccupante dato il disprezzo delle vite dei civili testimoniato durante l’invasione».

Davvero non c’è alcun quadro normativo di riferimento?

«Al momento non esiste un quadro normativo che regoli l’uso dell’Ai in contesti di guerra. Certo, il diritto umanitario internazionale si applica, ma non basta. La sfida cruciale è che le leggi e regole esistenti danno per scontato che un essere umano controlli i sistemi che vengono utilizzati. Ma chi è responsabile, nel caso in cui invece un sistema sia in grado di prendere decisioni davvero autonome, da sé? Attualmente, nessuno».

La guerra in Ucraina rende ancora più urgente regolare l’uso di armamenti intelligenti?

«C’è un bisogno urgente di sviluppare regole per l’uso dell’Ai in guerra, prima che sia un qualche evento catastrofico a costringerci a farlo. Naturalmente anche sviluppare un insieme di regole preventive non è privo di rischi, ma gli Stati possono comunque cominciare a posarne le fondamenta. Le discussioni in sede Onu, per quanto lente, sono state comunque importanti; ora tuttavia c’è bisogno di azioni concrete. Senza norme e regole tra Stati c’è il rischio di escalation del conflitto, o che queste armi proliferino anche tra gruppi armati non afferenti allo Stato».

Queste regole dovrebbero stabilire anche una differenza tra usi problematici ma ammissibili e usi che invece vanno messi al bando?

«Gli Stati dovranno accordarsi su certi limiti e stabilire diverse categorie di rischio. Per esempio, andrebbero proibiti i sistemi che identificano bersagli senza alcun significativo controllo umano. Allo stesso modo andrebbero proibiti usi “intelligenti” di armi già proibite, nucleari, chimiche o biologiche. Dovrebbe inoltre venire considerato l’impatto di questi sistemi sui civili e le infrastrutture civili».

Ma esiste una buona strategia per contenere la corsa agli armamenti intelligenti?

«Alcuni tra i più importanti tecnologi e scienziati al mondo si sono espressi molto chiaramente sul bisogno di regole contro l’abuso dell’AI in guerra, e ne servono altre ancora. C’è bisogno che chi sviluppa queste tecnologie continui a manifestare in pubblico le proprie preoccupazioni. Ciò che manca sono la volontà e la leadership politica degli Stati. Smuovere quella volontà politica è cruciale».