Innovazione

2 ottobre, 2025L’efficienza della pubblica amministrazione resta una promessa. Si moltiplicano gli impieghi in campo militare e sulla sicurezza. Con il pericolo di gravi manipolazioni

L’Ia renderà il potere più equo e più efficiente, a beneficio di tutti. Questa la promessa, finora rimasta tale. Le minacce che gravano sulle democrazie, in compenso, si stanno realizzando appieno. Lì sì che l’intelligenza artificiale comincia a fare la differenza, spalancandoci un futuro dove saremo in balia di poteri opachi, armati dall’Ia.

Il bilancio a oggi sembra impietoso, ma è il solo che emerga chiaro dai fatti. Il bene che l’Ia può fare alla società resta potenziale, il male ci è già sul collo. Una conferma è anche tra le righe della prima legge italiana sull’intelligenza artificiale (e una delle prime al mondo) che, su iniziativa del governo, il Parlamento ha approvato in via definitiva il 17 settembre.

La promessa, appunto: «Le pubbliche amministrazioni utilizzano l’intelligenza artificiale allo scopo di incrementare l’efficienza della propria attività», si legge. Per «ridurre i tempi dei procedimenti», «aumentare la qualità e la quantità dei servizi» ai cittadini e alle imprese. La legge (collegandosi al regolamento Ai act europeo) ribadisce qui e lì i diritti fondamentali da tutelare. Contro il rischio che cittadini (e umani) perdano voce in capitolo, su temi di pubblico interesse come pensioni, giustizia, sanità.

Il governo riconosce quindi, di riflesso, il peso di un lato oscuro che grava sulle nostre libertà. L’Ia «non deve pregiudicare lo svolgimento con metodo democratico della vita istituzionale e politica», «non deve altresì pregiudicare la libertà del dibattito democratico da interferenze illecite». Si evoca così la minaccia della disinformazione, anche da parte di potenze straniere.

«Secondo il nostro ultimo report, il tasso di false informazioni prodotte da chatbot Ia è quasi raddoppiato in un anno, dal 18% al 35%», dice Giulia Pozzi, viceresponsabile editoriale di NewsGuard per l’Italia, il principale osservatorio internazionale sulla disinformazione. «Già hanno avuto impatti significativi sulle democrazie e sui processi elettorali. Sulle elezioni in Africa, in Danimarca. In Italia e in Europa campagne di disinformazione orchestrate da attori esterni come Russia e Cina che si servono dell’Ia per moltiplicare contenuti falsi con l’obiettivo di interferire sulle elezioni, screditare istituzioni e polarizzare l’opinione pubblica», continua.

«Bisogna tutelare gli interessi della sovranità dello Stato», riconosce in merito la legge Ia italiana.

Ma c’è il sospetto che il lato oscuro abbia contaminato questa stessa legge, tradendo il desiderio di governo e maggioranza di usare la tecnologia per una sorveglianza selvaggia sui cittadini. Per controllare e sopprimere ogni dissenso. È l’accusa di Rete per i diritti umani digitali, coalizione delle principali organizzazioni della società civile (The Good Lobby, Amnesty International Italia, Hermes Center, Period Think Tank, Privacy Network e Strali), secondo cui ne verrà una nuova ridda di decreti securitari: perché la legge consente una sorveglianza di massa con riconoscimento facciale (stadi, piazze, supermercati…) e accentra nelle mani del governo l’autorità in materia Ia. Pur contro la richiesta del regolamento europeo di nominare un’autority indipendente. Bocciati gli emendamenti di Partito democratico, Alleanza Verdi e Sinistra e Movimento5Stelle, che stabilivano forti tutele in merito.

«Senza dubbio il principale interesse del potere nei confronti dell’Ia, anche nei Paesi democratici, riguarda gli usi militari e la sorveglianza», dice Juan Carlos De Martin, ordinario di Informatica al Politecnico di Torino e cofondatore dello storico centro Nexa su Internet e Società.

Due ambiti che ormai si confondono, del resto, come dimostrano gli strumenti Ia con cui Israele analizza i profili dei palestinesi per calcolarne il rischio terroristico, li identifica con sistemi di riconoscimento facciale ed eventualmente li uccide poi con droni “intelligenti”.

«L’Ia permette di profilare le nostre idee politiche, analizzando i nostri social e, tramite la posta di Google, ora anche la nostra corrispondenza – dice De Martin – Lo fanno già gli Usa per bloccare gli antirepubblicani o filo palestinesi alla frontiera».

Ma questa tendenza emerge qui e lì anche nella normale vita quotidiana. «Ci sono laboratori diffusi di sorveglianza e controllo con Ia. Per esempio alle frontiere sugli immigrati, in Europa. Tecnologie che poi saranno adoperate su tutti noi», aggiunge Carlo Blengino, avvocato del centro Nexa. Sembra di ascoltare Prima di tutto vennero a prendere gli zingari.

«Il potere ragiona così: se può sorvegliare, lo fa. E l’Ia glielo permette come mai prima», aggiunge. «Piccoli grandi segnali preoccupanti: le telecamere “intelligenti”, ossia con Ia, che si diffondono sulle strade, per capire chi commette infrazioni, per esempio sulle cinture di sicurezza», continua Blengino. «Si parla di telecamere antispaccio, pure, che identificano attività e persone. Il problema è il costo democratico di queste operazioni, quanta libertà cediamo in nome della sicurezza», aggiunge.

Un noto esperto come Giovanni Boccia Artieri, ordinario di Sociologia a Urbino, rileva come il male si annidi anche nelle (presunte) buone intenzioni del potere: «Se in nome dell’efficienza affidiamo alcune decisioni importanti all’Ia – in sanità, giustizia, welfare – c’è un rischio di base: di mettere fuori gioco la discrezionalità umana, quell’area di grigio che è alla base degli equilibri democratici». C’è poi una minaccia più sottile: «Quella che negli anni 70 si chiamava tecnocrazia. Se in fondo a decidere è l’Ia, si pregiudica il ruolo delle istituzioni e la fiducia nelle stesse, a danno di pluralismo e partecipazione», aggiunge. Concorda Laura Sartori, sociologa all’università di Bologna: «Un candidato indipendente alle ultime elezioni nel Regno Unito ha detto che si sarebbe fatto aiutare da un chatbot, nelle decisioni. È stato giustamente criticato: così non si sa più chi decide, il rappresentante eletto o una macchina, dietro cui peraltro ci sono le scelte opache delle big tech americane».

È il lato oscuro degli stessi presunti “usi benèfici” dell’Ia, in fondo. Come l’aumento della trasparenza della macchina pubblica e la lotta alla corruzione. Alcune città europee (Barcellona, Helsinki) usano algoritmi per analizzare i dati della pubblica amministrazione, identificare anomalie negli appalti e monitorare la spesa pubblica. Anac, l’autorità anticorruzione, ha un progetto simile in Italia; idem l’Agenzia delle Entrate, a caccia di evasori. «Sono solo sperimentazioni, però. Primo, perché c’è poco interesse politico a condurle: anche gli evasori votano; secondo, la tecnologia stessa è poco affidabile, per la scarsa qualità dei dati disponibili», dice Luca Gastaldi, che segue i temi dell’Ia pubblica per gli osservatori del Politecnico di Milano. Così, il rischio errori è alto, «nel 2021 la piattaforma Ia per il welfare in Danimarca si è macchiata di gravi discriminazioni; il governo si è dovuto dimettere», aggiunge.

Non illudiamoci però che questi limiti tecnologici ci possano salvare. È solo questione di tempo perché si risolvano. Allora la macchina sarà sguinzagliata e bisognerà sperare che istituzioni e società civile siano forti abbastanza perché a prevalere siano gli intenti davvero benefici. «L’Ia diventerà sempre più parte integrante e centrale dei processi decisionali pubblici. Ma senza un sistema di regole e controlli adeguati, quegli stessi strumenti in grado di portare un beneficio alla collettività possono essere facilmente deviati in strumenti di controllo, abuso e repressione», riassume il giurista Rocco Panetta.

LEGGI ANCHE

L'E COMMUNITY

Entra nella nostra community Whatsapp

L'edicola

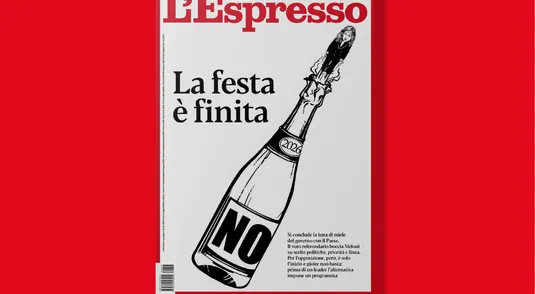

La festa è finita - Cosa c'è nel nuovo numero de L'Espresso

Il giornale, da venerdì 27 marzo, è disponibile in edicola e in app