Innovazione

12 settembre, 2025La rete è invasa da foto del presunto omicida della Utah Valley University, ma sono state generate dagli utenti usando le immagini diffuse dall’Fbi

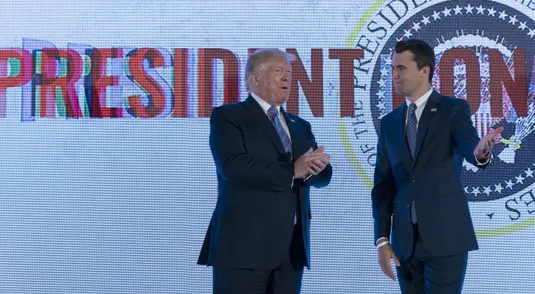

Siamo tutti Sherlock Holmes. E se l’Fbi pubblica un post con le foto, sgranate, del presunto assassino dell’influencer Maga, Charlie Kirk, dicendo: “Chiediamo l’aiuto di tutti per identificare questa persona, coinvolta nell'omicidio alla Utah Valley University”, gli utenti si attivano, immediatamente. Ma in una maniera inattesa.

Le foto erano state pensate per raccogliere eventuali segnalazioni, alla “Chi l’ha visto”, per intenderci. Ma l’effetto che hanno innescato è stato di altra natura: i social si sono riempiti di “ricostruzioni” digitali del presunto killer. A darne per primo evidenza è stato il sito The Verge, che ha raccolto alcune delle foto realizzate dagli utenti con l’AI.

Nella versione ufficiale si vede un ragazzo con il cappellino e gli occhiali da sole, scuri, ma nelle ricostruzioni “made in AI” il sospetto appare addirittura senza occhiali, con lo sguardo dritto in camera.

Il limite naturale di questa operazione è presto detto: “Gli strumenti di IA non scoprono dettagli segreti in un’immagine sfocata, ma deducono cosa potrebbe esserci”, si legge su The Verge. In pratica gli algoritmi di AI sono programmati per “riempire gli spazi vuoti” con particolari plausibili ma inventati, dal colore degli occhi ai lineamenti del volto. La stessa tecnologia che ritroviamo in molti smartphone che includono funzioni di intelligenza artificiale nelle app fotografiche, capaci di rapide attività di editing fotografico, che non richiedono alcuna competenza tecnica.

L’AI incriminata sarebbe proprio Grok – l’IA resident di X – ma anche ChatGPT, che hanno prodotto rielaborazioni differenti delle foto diffuse dall’FBI. Lo Stato dello Utah ha pubblicato immagini più nitide del giovane sospettato, con dettagli visibili come lo zaino e le scarpe.

Il rischio è che le immagini e le informazioni generate artificialmente possano far partire una “caccia alle streghe” che, come riportato dalla testata The Hindu, avrebbe puntato il dito accusando, ad un ceto punto, un democratico dello Utah di nome Michael Mallinson, attribuendo la notizia a Cnn. Ma era tutto falso, inventato da Grok e ChatGPT.

“Le notizie spesso innescano una frenetica ricerca di nuove informazioni sui social media – si legge su The Hindu – portando a false conclusioni che poi i chatbot ripropongono, contribuendo ad aumentare la disinformazione”.

Il caos del Bias, verrebbe da dire. Di sicuro questa è la dimostrazione del fatto che il mix fra “voyerismo delle news” e strumenti tecnologici avanzati possa generare un pericoloso cortocircuito informativo. L’AI può essere usata per rendere leggibili immagini poco chiare, ma non può sostituire prove certe né verifiche giornalistiche: nelle indagini reali, i dati e le prove restano l’unico terreno affidabile.

LEGGI ANCHE

L'E COMMUNITY

Entra nella nostra community Whatsapp

L'edicola

Perché dico No - Cosa c'è nel nuovo numero de L'Espresso

Il settimanale, da venerdì 20 marzo, è disponibile in edicola e in app