Innovazione

27 marzo, 2026Il rapporto AI Index 2025 di Stanford lo dice in modo brutale: i benchmark introdotti nel 2023 per mettere alla prova i sistemi più avanzati hanno visto i punteggi schizzare in alto di decine di punti percentuali in appena un anno. Il paradosso finito al centro di un dibattito quasi filosofico in corso nella Silicon Valley

C’è un grafico che sta facendo impazzire la Silicon Valley. Non perché sia complesso, ma perché è fin troppo chiaro: una linea che sale, sempre più ripida. Il punto è che rappresenta qualcosa di molto più sfuggente: l’intelligenza artificiale che migliora e lo fa a una velocità tale che, ormai, persino gli esperti fanno fatica a misurarla. Il grafico in questione è prodotto da Metr, un istituto di ricerca non-profit che valuta le capacità di sviluppo software dei modelli di Ia (consultabile a questo link: https://metr.org/time-horizons/?utm_source=chatgpt.com). Da mesi, raccontano i ricercatori, l’Ia raddoppia le proprie capacità circa ogni sette mesi, seguendo una curva esponenziale che non solo continua, ma sembra accelerare.

L’ultimo modello analizzato ha battuto tutti i record precedenti, facendo passare il clima nella comunità tech da febbrile a francamente allarmato. Il punto non è solo che sta migliorando. Il punto è che non sappiamo più come valutare quanto sia migliorata davvero e quando perdi la capacità di misurare un fenomeno, di solito è perché quel fenomeno ti sta sfuggendo di mano.

Fino a ieri avevamo benchmark, test, classifiche: l’Ia batte l’uomo negli scacchi, poi nel Go, poi nei quiz televisivi. Oggi questi indicatori sembrano già vecchi nel momento in cui vengono pubblicati. I modelli passano da “impressionanti” a “superati” nel giro di pochi mesi, e il rischio è che stiamo usando strumenti del passato per leggere qualcosa che appartiene già al futuro.

Il rapporto AI Index 2025 di Stanford lo dice in modo brutale: benchmark introdotti nel 2023 per mettere alla prova i sistemi più avanzati hanno visto i punteggi schizzare in alto di decine di punti percentuali in appena un anno. Test pensati per durare anni vengono “saturati” in mesi. È un problema molto più serio di quanto sembri, perché tutta l’economia dell’Ia – investimenti, regolazione, strategia aziendale – si basa su una domanda semplice: quanto è potente davvero questa tecnologia? Se la risposta diventa incerta, tutto il resto traballa. Non è un caso che anche chi lavora nel settore inizi a mostrare segnali di disagio. Joel Becker, ricercatore di Metr, lo ha ammesso a Sky News: «Siamo sempre più nervosi riguardo alle misurazioni che pubblichiamo». Il motivo? L’intervallo di incertezza sui risultati è diventato enorme, e una ragione fondamentale è che sta diventando sempre più difficile trovare compiti abbastanza complessi da mettere davvero alla prova l’Ia. Il che, di per sé, racconta già una storia. Piccoli cambiamenti nei test possono alterare drasticamente i risultati, rendendo difficile capire se stiamo davvero assistendo a un’accelerazione o a un’illusione statistica.

Un recente studio dell’Oxford Internet Institute ha messo il dito nella piaga, scoprendo che oltre un quarto dei benchmark più utilizzati si basa su campionamenti di convenienza piuttosto che su metodologie rigorose. Come ha detto il ricercatore Andrew Bean: senza definizioni condivise e misurazioni solide, diventa difficile capire se i modelli stiano davvero migliorando o sembrino soltanto farlo. Altri fanno notare che i modelli stanno migliorando in modo così rapido su compiti reali – come la programmazione – da rendere obsoleti i sistemi di valutazione tradizionali.

In altre parole: l’Ia non solo corre, ma cambia continuamente il terreno sotto i nostri piedi. E questo apre una questione più profonda, quasi filosofica. Per decenni abbiamo pensato all’intelligenza come qualcosa di misurabile: punteggi, test, Qi.

Ora ci troviamo davanti a macchine che migliorano in modi che non sappiamo più sintetizzare in un numero. È un po’ come cercare di valutare internet negli anni ’90 contando il numero di pagine web: tecnicamente corretto, ma completamente inutile per capire l’impatto reale. Il rischio, quindi, non è solo tecnologico ma cognitivo. Stiamo perdendo il linguaggio per descrivere ciò che sta accadendo e, solitamente, quando succede, la storia insegna che tendiamo a reagire in due modi opposti: o minimizziamo («è solo hype»), o esageriamo («cambierà tutto domani»). Probabilmente entrambe le reazioni sono sbagliate. Persino Demis Hassabis, tra i leader dell’Ia considerato il più misurato, ripete spesso che l’intelligenza artificiale avrà un impatto dieci volte superiore a quello della Rivoluzione industriale, in un decimo del tempo.

La verità è più scomoda: siamo dentro una fase di transizione in cui l’Ia sta diventando una infrastruttura, non più un prodotto. E le infrastrutture, per definizione, sono difficili da misurare mentre si stanno formando. L’elettricità, all’inizio, non si misurava in “impatto sociale”, ma in lampadine accese. Solo dopo abbiamo capito cosa significava davvero. Intanto, le statistiche sull’occupazione nel Regno Unito e negli Stati Uniti non mostrano ancora segni di impatto significativo, e gli annunci per ingegneri del software stanno addirittura aumentando. Ma come ha avvertito lo stesso Becker, le statistiche economiche fotografano quello che accadeva mesi fa, non quello che sta succedendo oggi. È lo stesso problema del grafico: quando i numeri arrivano, il mondo è già cambiato. Oggi siamo nello stesso punto con l’intelligenza artificiale. Solo che questa volta la curva è molto più ripida e mentre proviamo ancora a capire come leggerla, lei continua a salire.

LEGGI ANCHE

L'E COMMUNITY

Entra nella nostra community Whatsapp

L'edicola

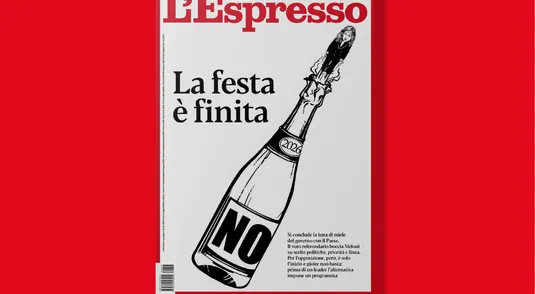

La festa è finita - Cosa c'è nel nuovo numero de L'Espresso

Il giornale, da venerdì 27 marzo, è disponibile in edicola e in app